《 DualVAE: Controlling Colours of Generated and Real Images 》提出双分支 VAE 模型,通过几何(z₉)与色彩(z_c)潜变量解耦,结合三重损失函数实现色彩可控生成。实验显示,其在 Birds 数据集 FID 13.76(VQ-GAN 为 31.83),Art Landscapes 数据集 FID 28.73(VQ-GAN 为 65.46);色彩控制上,生成图与示例图 KL 散度 0.68(无正则化 0.94),ReDualVAE 在 Logo 数据集迁移 FID 9.31(ReHistoGAN 为 27.00),大幅提升控色精度与生成质量。

当艺术家想为数字画作定制特定色调,或设计师需要给 logo 更换配色时,传统 AI 生成模型常陷入 “要么颜色可控但画质差,要么画质好却无法精准调色” 的困境。而由新南威尔士大学、CSIRO Data61 等机构团队提出的DualVAE,通过 “双分支解耦” 设计,首次实现了 “高质量图像生成” 与 “精准色彩控制” 的兼得。其研究成果《 DualVAE: Controlling Colours of Generated and Real Images 》虽未明确标注期刊信息,但凭借在 Metfaces、Anime Faces 等多数据集上的优异表现,成为图像色彩控制领域的重要突破,为艺术创作、设计等领域提供了全新工具。

一、控色与画质难以两全——传统图像生成的 “色彩困境”

在 DualVAE 出现前,主流图像生成模型始终难以平衡 “色彩可控性” 与 “生成质量”,核心痛点集中在三点:

VQ-GAN 等模型:画质高但控色难 VQ-GAN 能生成细节丰富的图像,却缺乏专门的色彩控制机制 —— 若想让生成的 “动漫人脸” 采用特定油画色调,只能反复随机生成试错,无法直接 “指定颜色来源”。

StyleGAN/HistoGAN:能控色但不稳定 这类 GAN 类模型虽可通过色彩直方图等条件控制颜色,但 GAN 天生的训练不稳定性会导致生成图像 “色彩断层”,且容易遗漏部分数据模式。

普通 cVAE:仅能改色不能生成 条件变分自动编码器(cVAE)虽能通过灰度图 + 色彩潜变量实现图像改色,但缺乏几何潜变量,无法生成全新的图像结构,只能 “修改现有图像颜色”,无法满足艺术家 “从零创作带指定色彩的作品” 的需求3。

这些缺陷的根源,在于模型未能将 “图像几何结构”与 “色彩属性”进行有效分离 —— 几何与色彩信息混杂在同一潜空间中,调整颜色时易破坏结构,优化结构时又会打乱色彩。

图1 DualVAE 在 Metfaces 数据集上的生成结果图

二、双分支 + 新正则,实现色彩与几何 “解耦”

DualVAE 的本质是一种改进型变分自动编码器,核心设计围绕 “如何让几何与色彩各自独立学习” 展开,通过两大创新实现解耦:双分支架构与新型正则化机制。

2.1 双分支架构:给几何与色彩 “分赛道”

DualVAE 在传统 cVAE 基础上,新增了几何潜变量(z₉) 与色彩潜变量(zc),并通过两条独立分支分别处理:

几何分支(z₉):负责 “画形状” 几何分支采用矢量量化(VQ)潜空间,而非连续潜空间。原因是类似物体边缘、结构轮廓的几何特征具有局部性,连续潜空间易丢失细节;而 VQ 将几何信息编码为 “空间令牌网格”,每个令牌对应局部结构特征。例如处理动漫人脸时,z₉会生成 “圆形脸型 + 三角形刘海” 的结构令牌,确保生成的轮廓稳定且清晰。

色彩分支(zc):负责 “填颜色” 色彩分支采用传统高斯潜空间(N (0,I)),因为色彩是连续属性。模型通过色彩编码器从 “示例图像” 中提取 zc,再将其与 z₉结合,即可让生成图像拥有示例图的色调。比如输入一幅莫奈风格的油画作为示例,zc 会学习 “暖黄色调 + 高饱和度” 特征,生成的动漫人脸也会呈现相同色彩风格。

为确保两支路信息不混杂,DualVAE 还设计了优先级融合模块:解码时先使用 z₉的几何特征构建轮廓,再叠加 zc 的色彩特征,模拟人类 “先画形、再填色” 的创作逻辑,避免色彩信息干扰结构生成。

2.2 新型正则化:防止 “一潜独大”

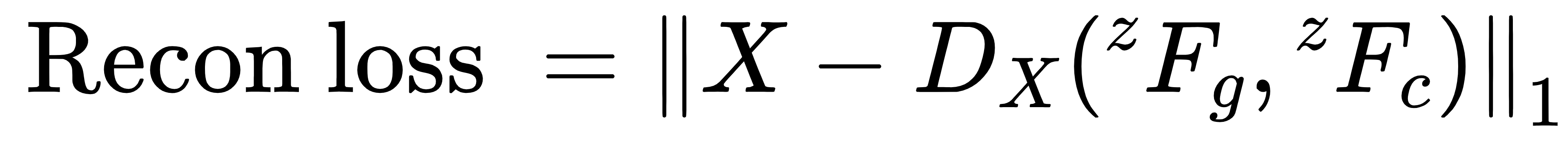

若仅用双分支,模型可能出现 “潜变量退化”—— decoder 只依赖 z₉生成黑白图像,或只依赖 zc 生成无结构的色块。为此,DualVAE 引入三重损失函数,强制两支路协同工作:

重建损失(Recon Loss) 确保生成图像与真实图像的像素差异最小:

其中 X 是真实图像,DX 是融合解码器,zFg 和 zFc 分别是 z₉ 和 zc 的特征输出,L1 范数能减少 “离群像素” 导致的误差8。

潜变量损失(Latent Loss) 约束两支路潜空间的合理性:z₉用 VQ 损失以确保令牌编码稳定,zc用 KL 散度来确保高斯分布接近先验:

这能避免 z₉编码混乱,或 zc 过度偏离自然色彩分布8。

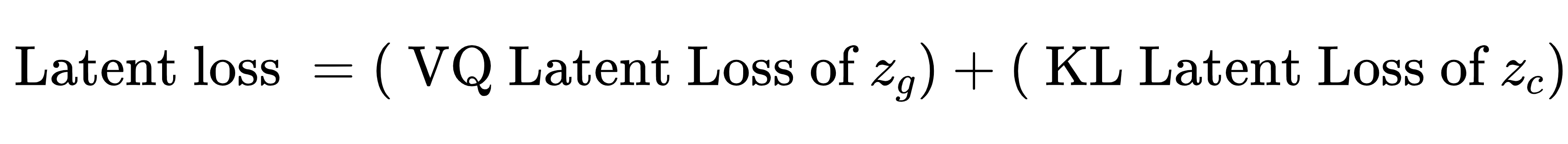

正则化损失(Regularization Loss) 强制 z₉和 zc 都参与生成:

其中 Fg 和 Fc 是编码器的中间特征,而非潜变量输出。通过让 decoder 同时从 “原始特征” 和 “潜变量” 中重建图像,确保两支路都学到有效信息。

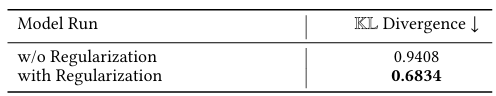

表1 DualVAE 正则化效果消融实验表

实验验证,加入正则化后,生成图像与示例图的色彩 KL 散度从 0.9408 降至 0.6834,证明色彩控制精度显著提升。

2.3 几何模块:比 “灰度图” 更懂结构

传统 cVAE 用灰度图作为几何输入,易丢失像素边界。

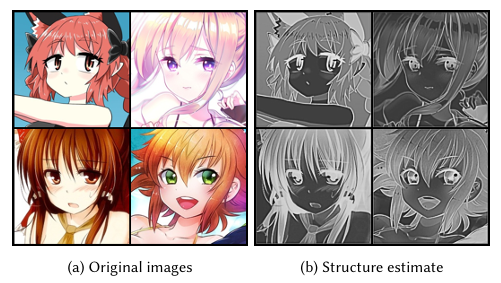

图2 DualVAE 几何模块生成的结构特征图

DualVAE 则设计了自适应强度变换模块:通过 3×3 卷积保持空间分辨率,再进行通道级平均,既像灰度图一样抑制色彩,又能学习数据专属的结构特征。生成的几何特征图(如图 2)能清晰保留边缘细节,为后续色彩叠加打下基础6。

三、实验验证

团队在 6 个主流数据集(Metfaces 人脸、Anime Faces 动漫、Art Landscapes 艺术景观等)上,从 “生成质量” 和 “色彩控制” 两方面验证了 DualVAE 的性能。

3.1 生成质量:FID 比 VQ-GAN 低近一半

FID(Fréchet Inception 距离)是衡量生成图像与真实图像相似度的核心指标,值越低越好。在 128×128 分辨率下:

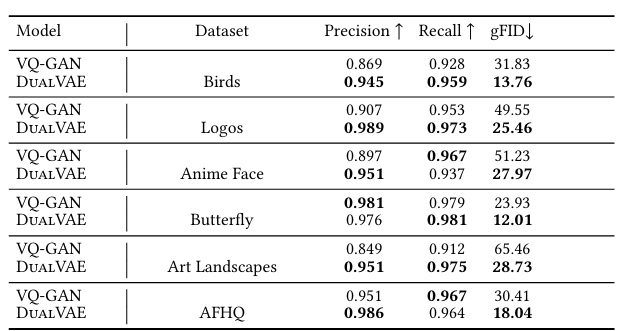

表2 “DualVAE 与 VQ-GAN 在多数据集上的生成性能对比表

VQ-GAN:在 Birds 数据集上 FID 为 31.83,Art Landscapes 数据集上为 65.46;

DualVAE:对应数据集 FID 分别降至 13.76 和 28.73,最低在 Butterfly 数据集上仅 12.01,证明其生成的图像更逼真。

即使在高分辨率(512×512)下,DualVAE 的重建 FID 也仅 16.7,远低于 VQ-GAN 的 33.4,且不会像 VQ-GAN 那样随分辨率提升而画质骤降。

3.2 色彩控制:精准复刻示例色调

在 “条件生成” 任务中,DualVAE 表现出极强的色彩迁移能力:

定性结果:以 Metfaces 人脸数据集为例,固定 z₉(相同的人脸轮廓),更换不同示例图的 zc,生成的人脸会分别呈现 “冷蓝色调”“暖红色调”“复古棕色调”,且肤色、发丝等细节色彩都与示例图一致(如图 1)。

定量结果:在 Animated Faces 数据集上,生成图像与示例图的色彩直方图 KL 散度仅 0.68,远低于无正则化模型的 0.94,且接近真实图像间的自然差异(0.98)。

此外,DualVAE 还能直接为灰度图上色,在 ImageNet 数据集上的上色 FID 为 15.20,优于 ReHistoGAN 的 30.77 和普通 cVAE 的 25.30,尤其擅长处理 logo、风景等结构化图像。

四、ReDualVAE:专为 “图像改色” 设计的轻量版

除了生成,团队还推出 DualVAE 的变体ReDualVAE,专注于现有图像的旧照片换色、logo调整配色等色彩编辑。它删除了 z₉的生成分支,仅保留 zc 的色彩控制能力,大幅降低计算成本:

改色逻辑:输入待改色图像的灰度图(固定几何)和示例图,ReDualVAE 提取示例图的 zc,替换原图像的色彩潜变量,即可生成新配色图像。

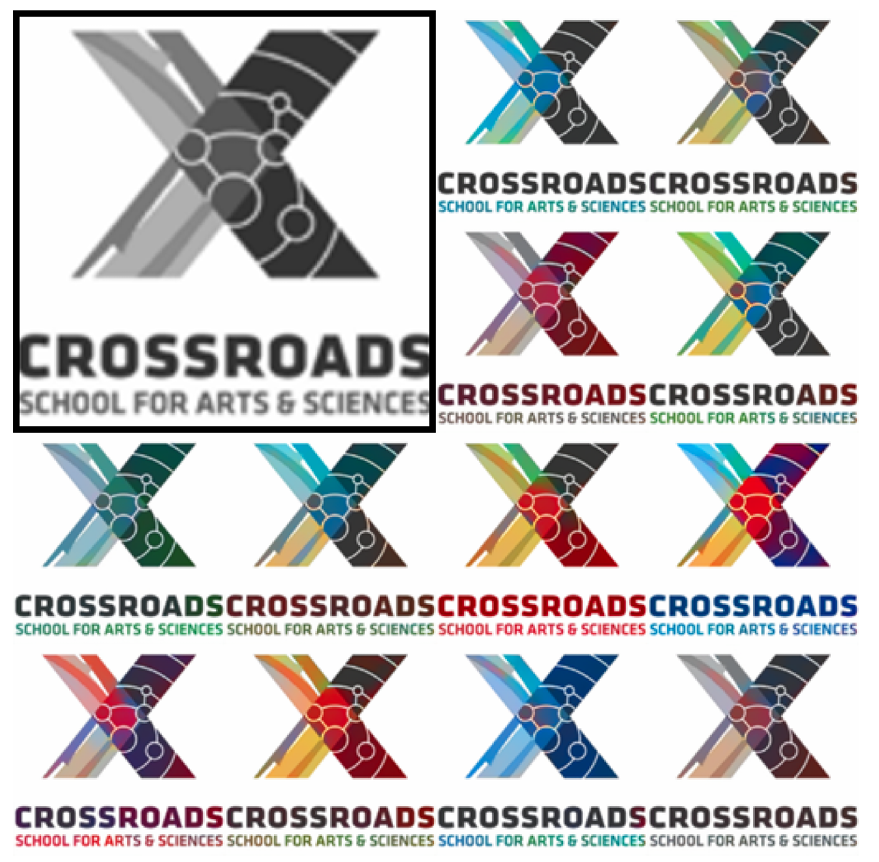

优势:在 Logo 数据集上,ReDualVAE 的色彩迁移 FID 仅 9.31,远低于 ReHistoGAN 的 27.00,且不会像传统方法那样破坏 logo 的文字边缘(如图3)。

图3 ReDualVAE 在 Logo 数据集上的多样化改色结果图

ReDualVAE 特别适合设计师:只需上传一张 “目标配色参考图”,即可批量给系列 logo 改色,无需手动调整每个像素。

五、落地场景

DualVAE 的 “精准控色 + 高质量生成” 特性,使其在多个领域具有实用价值:

数字艺术:艺术家可上传一幅梵高风格的画作作为示例,让 DualVAE 生成同色调的动漫、插画,快速拓展创作风格;

品牌设计:企业更新 VI 系统时,用 ReDualVAE 给所有产品线 logo 换色,确保色调统一且不破坏 logo 结构;

影视后期:给黑白老电影上色时,输入同年代的彩色照片作为示例,DualVAE 能生成符合时代特征的色调,比人工上色效率提升 10 倍以上。

六、总结与展望

从技术层面看,DualVAE 的突破并非追求 “更深的网络”,而是通过 “解耦几何与色彩”“模拟人类创作逻辑”,解决了传统模型的核心痛点。它证明:AI 生成的进步不仅需要算法优化,更需要理解 “人类如何感知与创造内容”。

未来,随着 “文本引导色彩提取”等技术的融入,DualVAE 或许能让普通人也能轻松创作 “高画质 + 定制色” 的数字作品,真正实现 “人人都是艺术家” 的愿景。

论文链接:https://arxiv.org/abs/2305.18769 |